自然语言处理NLP之BERT、BERT是什么、智能问答、阅读理解、分词、词性标注、数据增强、文本分类、BERT的知识表示本质 目录 自然语言处理NLP之BERT、BERT是什么、智能问答、阅读理解、分词、词性标注、数据增强、...

”自然语言处理 bert 人工智能 nlp 深度学习“ 的搜索结果

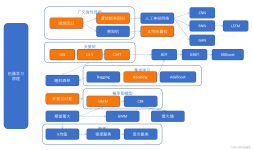

文件内容包括基于huggingface的BERT源码自定义类架构图以及基于Huggingface的bert源码TFBertModel API的两个文档。内容是通过对Huggingface源代码进行逐行阅读与解析得到,文档图均使用processon手绘可得,非常推荐...

【自然语言处理通用解决方案】 需要熟悉word2vec,RNN网络模型,了解词向量如何建模 重点在于Transformer网络架构,BERT训练方法,实际应用 开源项目,都是现成的,套用进去就OK了 提供预训练模型,基本任务拿过来...

基于bert的中文自然语言处理工具 包括情感分析、中文分词、词性标注、以及命名实体识别功能 提供了训练接口,通过指定输入输出以及谷歌提供的下载好的预训练模型即可进行自己的模型的训练,训练任务有task_name参数...

机器学习、深度学习、自然语言处理等人工智能基础知识总结以及源代码.zip 说明 机器学习、深度学习、自然语言处理基础知识总结。 目前主要参考李航老师的《统计学习方法》一书,也有一些内容例如XGBoost、聚类、...

自然语言处理(NLP)是人工智能领域的一个重要分支,旨在让计算机理解、生成和处理人类语言。随着深度学习技术的发展,NLP领域也得到了巨大的推动。BERT(Bidirectional Encoder Representations from Transformers)是...

全部两个衡量指标上...可以预见的是,BERT将为NLP带来里程碑式的改变,也是NLP领域近期最重要的进展。BERT模型开启了NLP的新时代!从现在的大趋势来看,使用某种模型预训练一个语言模型看起来是一种比较靠谱的方法。

ELMo根据上下文动态调整word embedding, 可以解决多义词的问题.GPT使用了Transformer提取特征, 使得模型能力大幅提升.第三种方式就是前后分别...第二种方式就是只保留后面510个token.bert + 迁移学习 简单练习代码。

自然语言处理从业者、深度学习爱好者 课程简介: 命名实体识别作为自然语言处理的基础技术之一,在自然语言处理上游各个任务(问答系统、机器翻译、对话系统等)重扮演者十分重要的角色,因此深入掌握命名实体识别...

Bert作为目前自然语言处理领域最流行的技术之一,文本分类作为自然语言处理领域最常见的任务之一,Pytorch作为目前最流程的深度学习框架之一,三者结合在一起将会产生什么样的花火,本套课程基于Pytorch最新1.4版本...

BERT(Bidirectional Encoder Representations from Transformers)是一种基于深度学习的自然语言处理(NLP)模型。它是由Google在2018年提出的,采用了Transformer架构,并在大规模语料库上进行了预训练。BERT的...

自然语言处理(Natural Language Processing,NLP)是人工智能领域中的一个重要分支,涉及到处理和理解人类语言的方法和技术。除了上述模型和技术之外,还有许多其他的深度学习模型和技术可以用于NLP任务,如卷积...

深度学习存在多个领域,NLP作为深度学习领域的一个主要分支其知识内容众多。本知识图谱总结了NLP领域的大部分重要的模型与算法。如词向量模型、bert、transformer模型。。。以及openai的利器GPT历代模型。通过该知识...

自然语言处理(NLP)是人工智能领域的一个重要分支,目的是让计算机能够理解和处理人类语言。随着深度学习技术的快速发展,NLP领域取得了突破性进展。本文将探讨深度学习在自然语言处理中的应用,并详细说明每个要点...

人工智能-项目实践-知识蒸馏-基于 Tensorflow,仿 Scikit-Learn 设计的深度学习自然语言处理框架 兼容 Tensorflow1.x/2.x 的高层封装 (Transformer/GPT-2/BERT/ALBERT/UniLM/XLNet/ELECTRA 等),使用简单的代码完成...

未来,随着计算资源和数据规模的持续增长,我们期待看到更加先进的优化方法和技术,以应对更大规模和更复杂的自然语言处理任务。例如,阿里巴巴的智能客服“阿里小蜜”和京东的“言犀”都是基于深度学习的智能客服...

然而,与之前的模型不同的是,BERT 是第一个深度双向、无监督的语言表示,仅使用纯文本语料库(在本例中为维基百科)进行预训练。BERT 还通过预训练一个非常简单的任务来学习建模句子之间的关系,该任务可以从任何...

BERT(来自变压器的双向编码器表示)是由Google开发的一种革命性的自然语言处理(NLP)模型。它改变了语言理解任务的格局,使机器能够理解语言中的上下文和细微差别。在本博客中,我们将带您踏上从BERT的基础概念到...

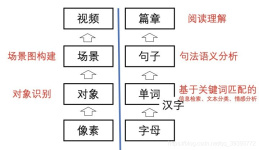

自然语言处理( Natural Language Processing, NLP)是计算机科学领域与人工智能领域中的一个重要方向。它研究能实现人与计算机之间用自然语言进行有效通信的各种理论和方法。自然语言处理是一门融语言学、计算机科学...

自然语言处理(Natural Language Processing,NLP)主要研究用计算机理解和生成自然语言的各种理论和方法,属于人工智能领域的一个重要甚至核心分支,是计算机科学与语言学的交叉学科,又常被称为计算语言学...

BERT模型代码已经发布,可以在我的github: NLP-BERT--Python3.6-pytorch 中下载,请记得start哦 目录 一、前言 二、如何理解BERT模型 三、BERT模型解析 论文的核心:详解BERT模型...

目前,人工智能领域中最热的研究方向当属深度学习。深度学习的迅速发展受到了学术界和工业界的广泛关注,由于其拥有优秀的特征选择和提取能力,对包括机器翻译、目标识别、图像分割等在内的诸...

推荐文章

- Pytorch Dataloader 模块源码分析(二):Sampler / Fetcher 组件及 Dataloader 核心代码-程序员宅基地

- Asp类型判断及数组打印-程序员宅基地

- Adroid Studio 2022.3.1 版本配置greendao提示无法找到_plugin with id 'org.greenrobot.greendao' not found-程序员宅基地

- esxi查看许可过期_解决Vsphere Client 60天过期问题-程序员宅基地

- CMake_cmake_module_path-程序员宅基地

- 生产者消费者模型-程序员宅基地

- Adaptive AUTOSAR 解决方案 INTEWORK-EAS-AP_autosar的eas-程序员宅基地

- 穿山甲SDK错误码40025_穿山甲sdk错误码4025-程序员宅基地

- css firefox下的兼容问题_css 只用于firefox-程序员宅基地

- 【Python】对大数质因数分解的算法问题_python分解多个质因数代码-程序员宅基地